机器之心报道编辑:泽南一举办理算力资源浪费。岂论是英伟达 GPU 还是昇腾的 NPU,都可以「融为一体」,动态切分了。11 月 21 日,华为正式宣布 了 AI 容器技能 ——Flex:ai,同时,华为团结上海交通年夜 学、西安交通

|

编辑:泽南

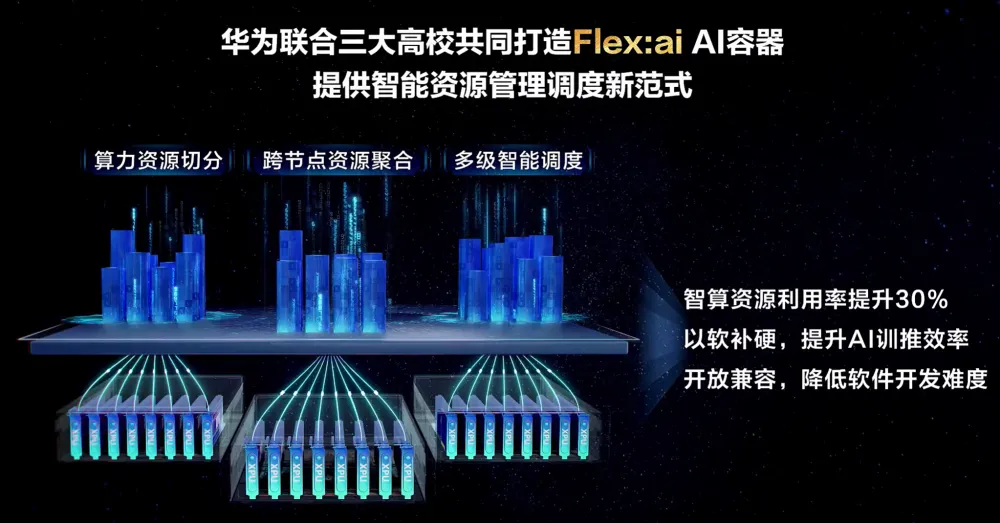

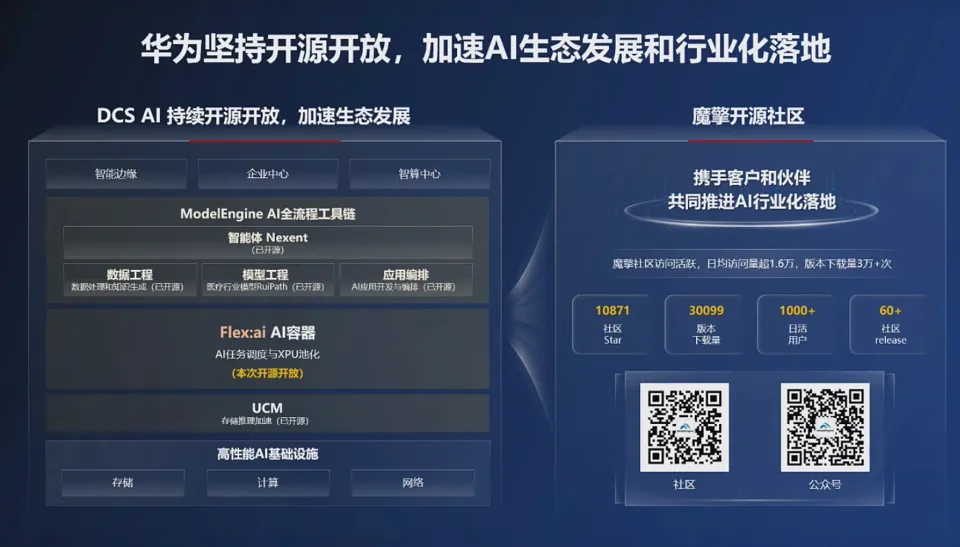

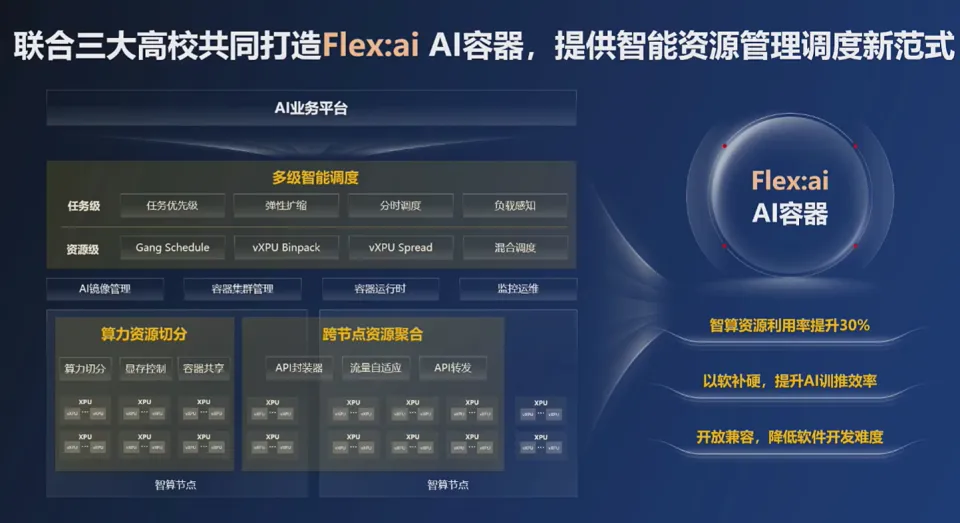

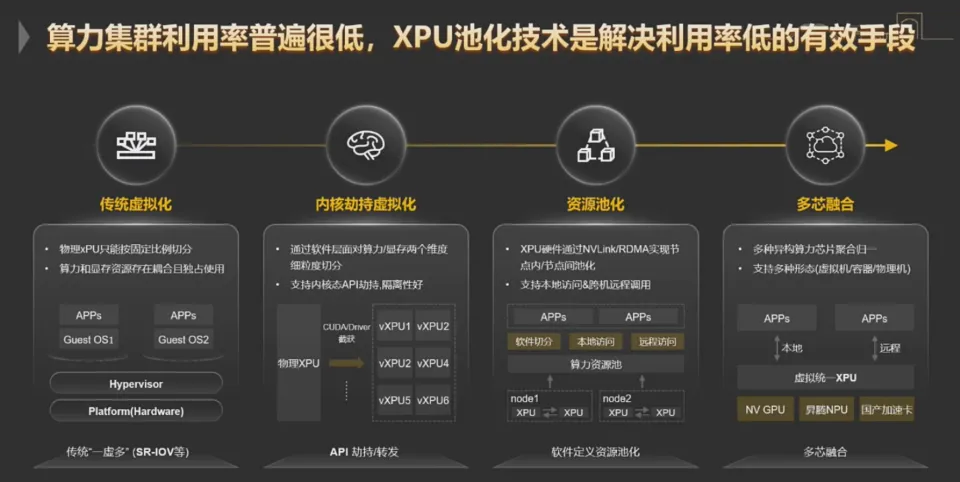

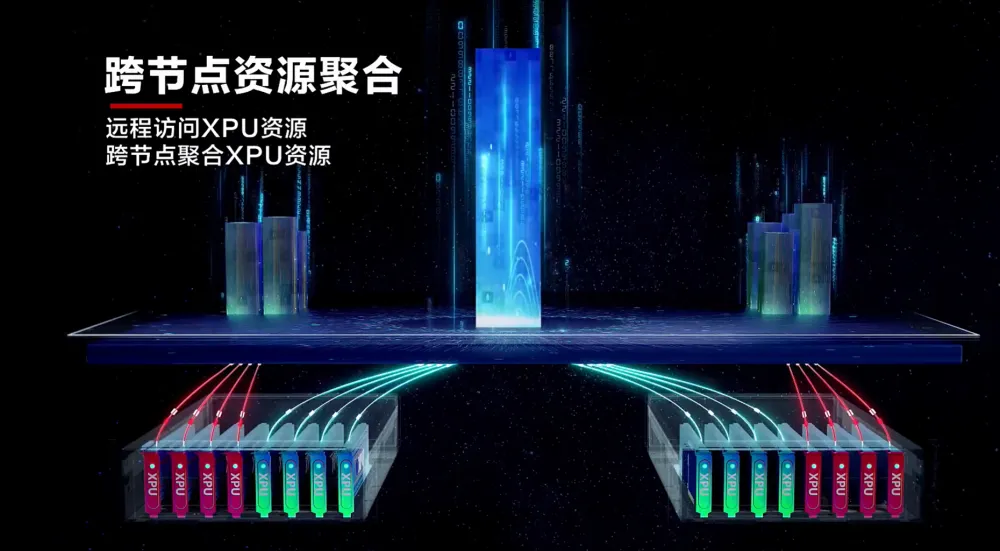

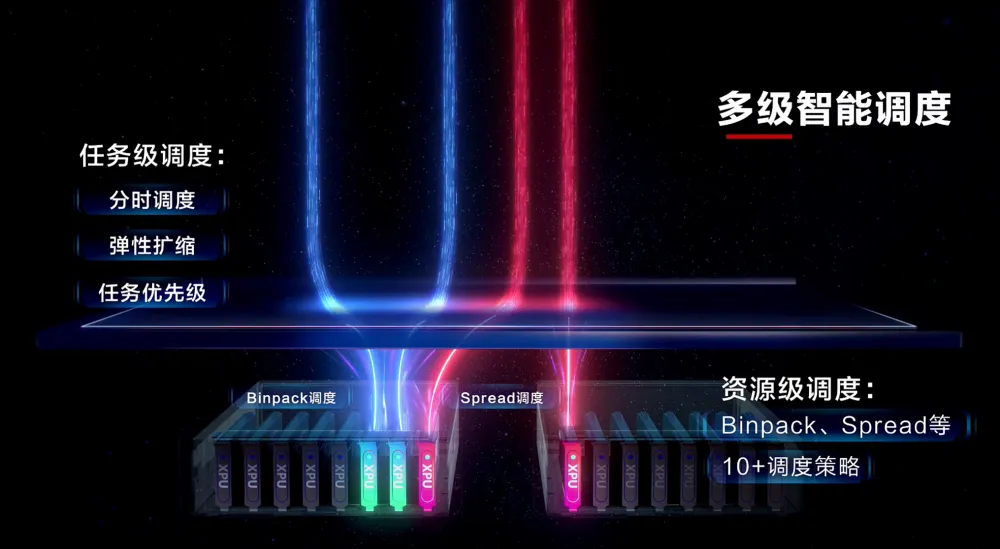

岂论是英伟达 GPU 还是昇腾的 NPU,都可以「融为一体」,动态切分了。 11 月 21 日,华为正式宣布 了 AI 容器技能 ——Flex:ai,同时,华为团结上海交通年夜 学、西安交通年夜 学与厦门年夜 学共同宣布,将此项产学相助结果向外界开源,助力破解算力资源利用艰苦 。  华为公司副总裁、数据存储产品线总裁周跃峰博士在宣布 会上表现,当前,AI 财产高速成长 催生海量算力需求,但举世算力资源利用率偏低的问题日益凸显,「算力资源浪费」成为财产成长 的症结 枷锁 :小模子任务独占整卡导致资源闲置,年夜 模子任务单机算力不敷难以支持,年夜 量缺少 GPU/NPU 的通用服务器更是处于算力「休眠」状态,供需错配造成严峻的资源浪费。 本次宣布 并开源的 Flex:ai XPU 池化与调度软件基于 Kubernetes 容器编排平台构建,通过对 GPU、NPU 等智能算力资源的精细化办理 与智能调度,能够 实现 AI 工作负载与算力资源的精准匹配,年夜 幅提升算力利用率。  华为宣布将 Flex:ai 周全 开源至「魔擎社区」,与此前开源的 Nexent 智能体框架、DataMate 数据工程等工具共同组成 了 ModelEngine 开源生态。  据先容,Flex:ai 深度领悟 了上海交通年夜 学、西安交通年夜 学、厦门年夜 学三年夜 高校与华为的科研力量,形成了三年夜 焦点技能突破:  算力资源切分,一卡变多卡,服务多个 AI 工作负载 针对 AI 小模子训推场景中「一张卡跑一个任务」大概造成的资源浪费问题,华为与上海交通年夜 学团结研发 XPU 池化框架,可将单张 GPU 或 NPU 算力卡切分为多份假造算力单元,切分粒度精准至 10%。 这一技能实现了单卡同时承载多个 AI 工作负载,且通过弹性灵活的资源隔离技能,可实现算力单元的按需切分,「用若干 ,切若干 」,使此类场景下的整体算力均匀利用率提升 30%,进步了单卡服务本领,与此同时,假造化机能 消耗控制在 5% 以内。  跨节点算力资源聚合,充分利用余暇 算力 针对年夜 量通用服务器因缺少 智能计算单元而无法服务于 AI 工作负载的问题,华为与厦门年夜 学团结研发跨节点拉远假造化技能。该技能将集群内各节点的余暇 XPU 算力聚合形成「共享算力池」,一方面为高算力需求的 AI 工作负载提供充足资源支持;另一方面,可让不具备智能计算本领的通用服务器通过高速收集 ,可将 AI 工作负载转发到远端「资源池」中的 GPU/NPU 算力卡中实行,从而增进 通用算力与智能算力资源领悟 。 据先容,厦门年夜 学筹划的上下文分离技能冲破了 XPU 的服务规模 限制,可以使集群外部碎片减少 74%,提升了 67% 高优作业吞吐量。  多级智能调度,实现 AI 工作负载与算力资源的精准匹配 面对算力集群中多品牌、多规格异构算力资源难以统一调度的痛点,华为与西安交通年夜 学共同打造 Hi Scheduler 智能调度器。该调度器可自动感知集群负载与资源状态,团结 AI 工作负载的优先级、算力需求等多维参数,对当地及远端的假造化 GPU、NPU 资源进行全局最优调度,实现 AI 工作负载分时复用资源。即便在负载频繁颠簸的场景下,也能保障 AI 工作负载的平稳 运行,让每一份算力都「物尽其用」。  跟着 AI 对算力需求的不断增加 ,资源办理 屈从 正在逐渐成为新的瓶颈。去年 7 月,英伟达以 7 亿美元完成了对以色列 AI 始创 公司 Run:ai 的收购,受到了业界的存眷 ,也引发了人们对于将来算力利用办法 的讨论。Run:ai 的技能焦点在于通过动态调度、GPU 池化和分片等技能优化 AI 计算资源的利用屈从 。据报道,其平台能够 将 GPU 资源利用率从不敷 25% 提升至 80% 以上。 开源的 Flex:ai 被视为对 Run:ai 等办理筹划 的正面回应。上海交通年夜 学戚正伟教授指出:「Flex:ai 的异构兼容性更优于 Run:ai,其开放架构将鞭策 国产算力生态标准化。」 通过 Flex:ai 周全 开源开放,华为及各方盼望汇聚举世立异 力量,共同鞭策 异构算力假造化与 AI 应用平台对接的标准构建,形成算力高效利用的标准化办理筹划 。 从「万卡集群」到「一卡多用」,Flex:ai 正试图重新定义 AI 时代算力的利用办法 。它的开源开放,将进一步鞭策 国产算力的年夜 规模应用。 |

2025-05-03

2025-03-05

2025-02-26

2025-03-05

2025-02-26