DeepSeek V3.1提及的UE8M0 FP8引爆了舆论,但我们也要清醒看到,其意义并非在于技术上的原创性突破,而是标记着国产AI财产链协同迈入新阶段。它的核心意图在于串联起芯片厂商适配、大年夜 模子工具链优化,冲破

|

迩来一周,半导体成为A股表现最强的板块。上半年利润仅10亿的寒武纪,以超过6000亿的市值跃居科创板首位,滚动市盈率高达500余倍,股价也一度超过茅台成为A股“股王”。 引爆市场情绪的,是上周DeepSeek V3.1的宣布 ——准确来说,甚至不是这款模子的本领自己,而是短短不到20个字的一则官方留言:“UE8M0 FP8是针对即将宣布 的下一代国产芯片筹划。”

UE8M0 FP8,立刻成了国产AI技术突破的最新代名词。 在一周高涨的情绪之后,本日的市场出现 正常回落。而与之相伴的,是中芯国际冷暖参半的半年报——上半年营收增长22%,Q2产能使用率高达92.5%,中国区收入占比提升至84.2%;但单看二季度,净利润和毛利润都出现 下滑。 究竟上,假如把DeepSeek、寒武纪、中芯国际们近期的一系列信息串联起来,我们在欣喜于其提高 之余,也可以或许看到国产AI生态仍受到严重限制,距离天下先进水平仍有差距。 但更大年夜 的惊喜在于,中国财产链的协同程度正在敏捷提升。

DeepSeek到底干了什么 UE8M0 FP8,这串如同乱码一般的字符,究竟有什么魔力? 我们不妨先从FP8提及。 FP8是一种8位浮点数,其根本道理 是用较少的字符来表现更复杂的数字,这对于使用二进制语言的计算机来说好坏常告急的。 这是因为 ,二进制数字只有0和1两个字符,一个较短的十进制数字,写成二进制大概会变得很长。举个例子,一个随机的十进制数字56.89,假如直接转换成计算机使用的二进制数字,是111000.11100011,字符异常 多,也就意味着会占用更多存储空间。 那么为了节省字符,人们发明白浮点数。 具体来说,所谓浮点数,是指一种特殊的数字表现格局 ,其根本格局 是把数字a写成m×b^e的形式。 例如,上述的111000.11100011,可以写成1.1100011100011×2⁵。假如我们乐意损掉 必定 的精度,规定 小数点后只保留3位,就约便是1.110×2⁵。这样 一来,只需要记载下小数点后的110和5次幂这两个信息,就能还原出原来 的数字了,存储空间占用量大年夜 大年夜 镌汰。 FP8就是这样 一种记载方法 ,规定 用8位二进制数来记载上述信息。例如拿出4位数记载幂值,另外3位数来记载110,剩下1位数记载正负。这种格局 叫做E4M3 FP8。 但是这内里仍旧有个问题:当数字比力大年夜 时,幂值会变大年夜 ,而4位二进制数最大年夜 仅相当于十进制的15,更大年夜 幂值就无法记载。E4M3 FP8最大年夜 就只能记载十进制-480到+480之间的数字。 想要表现更大年夜 数字,就要增长用于记载幂值的字符,镌汰记载前面数字的字符,但这会导致准确度继续变差。 而UE8M0 FP8,就意味着把全部 8位数字都用来记载幂值,而完整 舍弃小数点后的信息,以及正负值。 换句话说,UE8M0 FP8只能记载2,4,8,16……这样 2的整数次幂,其它数字都只能近似成这些数字,极大年夜 地牺牲了精度,以调换存储规模 。 明白了这一点,我们就可以来讨论DeepSeek为什么要使用UE8M0 FP8。 大年夜 模子的根本道理 ,是把笔墨、图像等信息,全部 用数字来表现,并预测哪些数字的相干性更高。 这些数字,就是人们常说的参数,而参数天然是规模 越大年夜 、越准确越好。 想要规模 和精度两者兼得,就需要用更多的二进制字符来记载。是以 ,过去很多大年夜 模子会使用FP16、FP32等格局 ,这意味着更大年夜 的存储量和算力斲丧。 而DeepSeek V3和R1这样 的模子,之所以可以或许降低算力本钱,就是因为 使用了FP8,以牺牲精度来调换速率。 但是,这种牺牲真的不可避免吗?这就要说到UE8M0了。 究竟上,DeepSeek并非所有数据都使用UE8M0格局 。如前所述,UE8M0的极端弃取,导致精度极差,是难以满意大年夜 模子练习需求的。 DeepSeek所做的,是引入UE8M0作为“缩放因子”,使用了microscaling的方法 。简朴明白,其参数仍旧以E4M3 FP8等格局 存储,以保证精度,并通过与另一个UE8M0 FP8数字相乘的方法 ,实现雷同FP32的效果,并节省75%的存储需求。 这种做法尽管增长了算法的复杂程度,但是仅仅在须要时才去做计算,仍旧可以或许大年夜 大年夜 节省算力和通信带宽需求。 这对于算力受到严重限制的国内大年夜 模子行业来说,天然是极为契合的思绪。

国产芯片“补课” 但是,我们也无需过分拔高DeepSeek V3.1的独创程度。 早在2023年,Meta、英特尔、谷歌等科技巨头推动的“开放计算项目(OCP)”就提出了MXFP8的microscaling数据格局 标准,以UE8M0作为缩放因子,而英伟达显卡也早已支持 UE8M0。国内的阿里、腾讯、百度等头部大年夜 厂,也都参与了这个项目。

2023年10月,OCP全球峰会在美国加州圣何塞举办 2023年,英伟达首席科学家比尔·戴利曾指出,驱动英伟达芯片机能 大年夜 幅提升的机密,已经不是芯片制程驱动的“摩尔定律”,而是数据格局 等身分 配合 驱动的“黄氏定律”,即通过引入较低精度的数字表现法,来镌汰对存储空间和计算资本 的斲丧,从而可以加快计算速率和效率。英伟达H100等显卡,就已经开始 支持 FP8格局 。 假如把眼光放到学术界,英伟达和加州理工的研究人员更是在2021年时就曾经发表过一篇论文《LNS-Madam:在对数数值体系中采用乘轨范 权重更新的低精度练习》,提出了雷同的数据转换方法 。 DeepSeek今年2月宣布 的高机能 计算库DeepGEMM中,也使用了UE8M0缩放因子。DeepGEMM恰是 针对英伟达显卡所做的优化,而国产显卡其时却普遍并不支持 这种格局 。 以至于当DeepSeek V3和R1问世时,国产显卡需要借助软件优化将FP8格局 转化成FP16,适配效果大年夜 打折扣。 是以 ,DeepSeek此次泄漏 的信息,大概重点并不在前半部门的UE8M0,而是后半部门的“针对下一代国产芯片筹划”。 近期,摩尔线程、芯原等国产芯片厂商也同步开释了适配UE8M0 FP8的消息 。 摩尔线程对观察者网指出,其旗舰产品MTT S5000是国内首批原生支持 FP8并已大年夜 规模量产的GPU。摩尔线程的MUSA架构原生支持 硬件FP8张量加快计算,可以或许完美支持 UE8M0 FP8 Scale,使用硬件原生FP8,相对于传统的FP16计算可以或许实现两倍的浮点算力提升、访存和通信带宽效率提升和存储容量使用率提升,同时最优化张量表达精度。

摩尔线程在WAIC 2025上宣布 了MTT S5000 但需要留意的是,尽管国产芯片逐步开始 支持 FP8格局 ,因为 差别品牌显卡在底层硬件架构上的差异,原来针对英伟达显卡筹划的算法也并非可以直接移植到国产芯片上。是以 ,大年夜 模子针对国产芯片的适配调整仍是一项告急工作。 “补课”,大概才是对现阶段工作更符合的表述。 这大概也表明了为什么DeepSeek R2延宕许久尚未问世。 是以 ,DeepSeek V3.1真正的意义,应当 不是对UE8M0 FP8这种数据格局 自己的应用,而是雷同于DeepGEMM这样 针对国产芯片的工具链筹划。 而且,DeepSeek特意提到是针对“下一代国产芯片”,这意味着国产大年夜 模子厂商与芯片厂商之间的协同配合达到了更高的层次 ,两边可以在硬件开辟阶段就配合 参与优化。 摩尔线程对观察者网表现,此举可以或许充实施展 出已量产的国产芯片架构特性,通过国产大年夜 模子和国产芯片协同筹划优化,实现1+1>2。

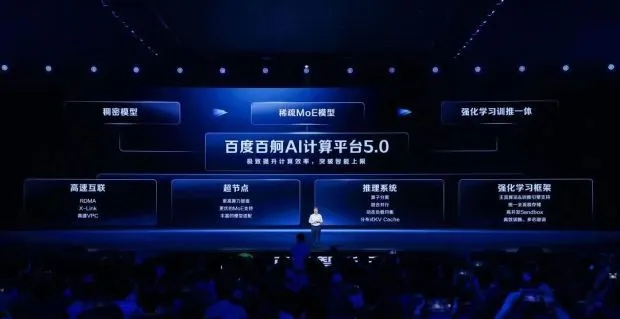

生态协同新高度 究竟上,谈到国产大年夜 模子与芯片的协同开辟,DeepSeek也不是唯一的参与者。 一方面,头部大年夜 厂往往已经通过自建生态的方法 ,早早结构软硬件协同,如华为昇腾、阿里平头哥、百度昆仑芯等。 本周,百度宣布 了百舸AI计算平台5.0,基于昆仑芯实现超节点,并针对DeepSeek引领的强化学习风潮,推出强化学习框架,极致压榨算力资本 。

2025百度云智大年夜 会上,百度智能云正式宣布 百度百舸AI计算平台5.0全新版本。 而更多的大年夜 模子初创公司,则通过与芯片厂商连合的方法 来提升适配效率。 今年7月,阶跃星辰连合近10家芯片及底子办法厂商发起“模芯生态立异 同盟”,首批成员包括华为昇腾、沐曦、壁仞科技、燧原科技、天数智芯、无问芯穹、寒武纪、摩尔线程、硅基运动等。 阶跃星辰连合创始人、副总裁朱亦博对观察者网指出,一款芯片的开辟周期需要两年以上,而现在模子迭代的速率只有半年到一年,假如让芯片厂商去适配模子,必然是低效的。现在,阶跃星辰盼望在国产芯片的开辟阶段,就自动去举办 适配,是一种更高效的方法 。 但我们也要清醒地看到,国产算力生态仍旧处于一种“戴着枷锁 跳舞”的状态 。 从中芯国际的财报可以看到,尽管国内繁茂的需求推动其产能使用率不断攀升,并且还有大年夜 规模扩产筹划,但是其告急营业 仍来自成熟制程。是以 ,其业绩并未如台积电那样充实受益于当下的算力高潮。 包括制程本领、HBM技术等限制,也让国产AI财产往往采用极限立异 的方法 ,在硬件受限的环境下用更高的本钱、更复杂的算法来压榨效率。 例如,华为不得不使用384个超多节点、昂贵的光通信等方法 来对标英伟达的NVLink72。其AI推理加快“黑科技”UCM,也是在HBM受限的环境下,告急针对“节流”举办 的立异 ;而道理 雷同的英伟达Dynamo,则更多聚焦于施展 高端算力集群的本领。 近期华为盘古大年夜 模子遭遇的争议和 收缩,也表现出中国企业尚难以依附单打独斗去全方位赢得全球AI竞争。以开放和协同的方法 汇聚国内全部 气力,才是更好的突围之道。 是以 ,近期国产AI财产一系列突破虽然 令人欣喜,但仍旧要看到,其真正意义并非在于单点的提高 ,而是在于财产链上鄙俚的信托和协作达到了一个新的高度,为未来中国全财产链的领先打下结实底子。 本文系观察者网独家稿件,文章内容纯属作者小我 观点,不代表平台观点,未经授权,不得转载,不然 将穷究 司法 义务 。关注观察者网微信guanchacn,逐日浏览 趣味 文章。 |

2025-05-03

2025-03-05

2025-02-26

2025-03-05

2025-02-26